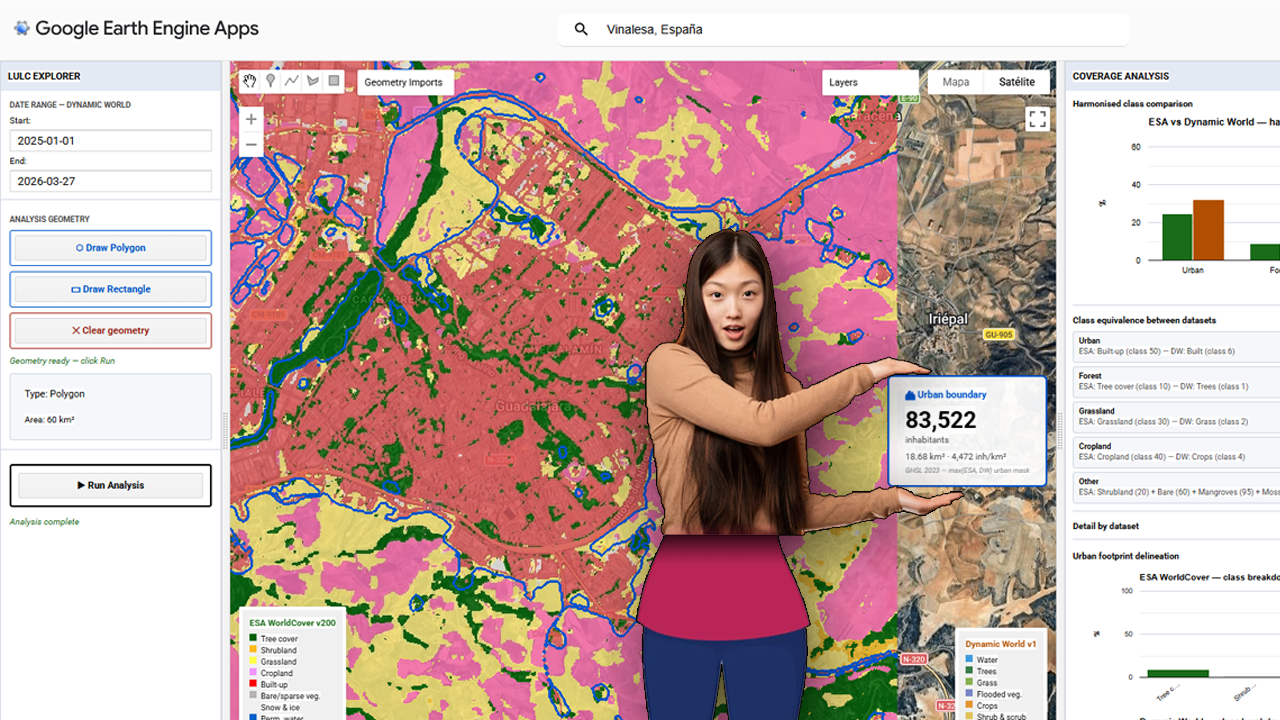

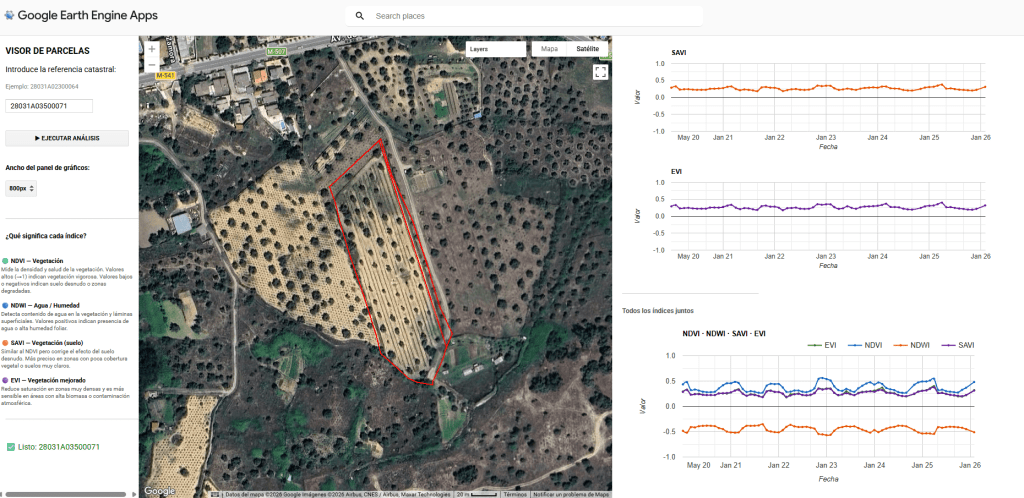

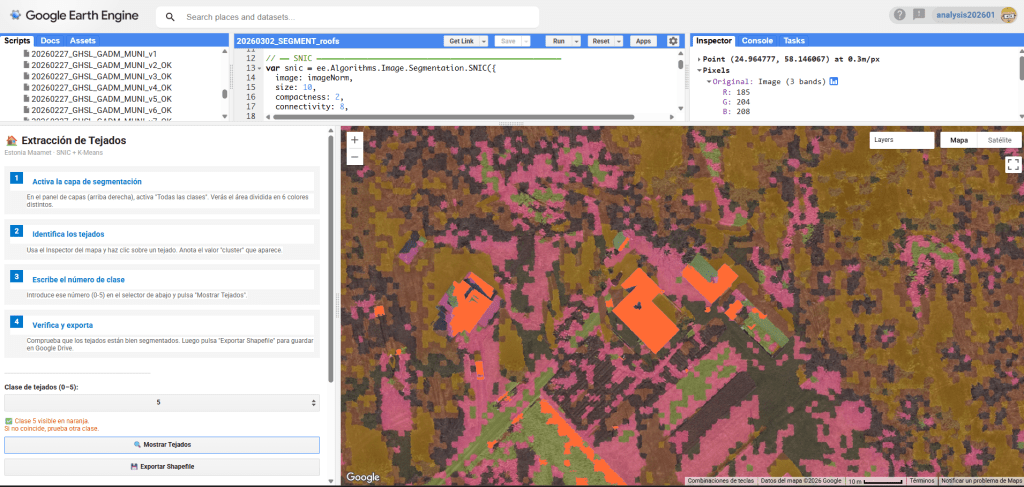

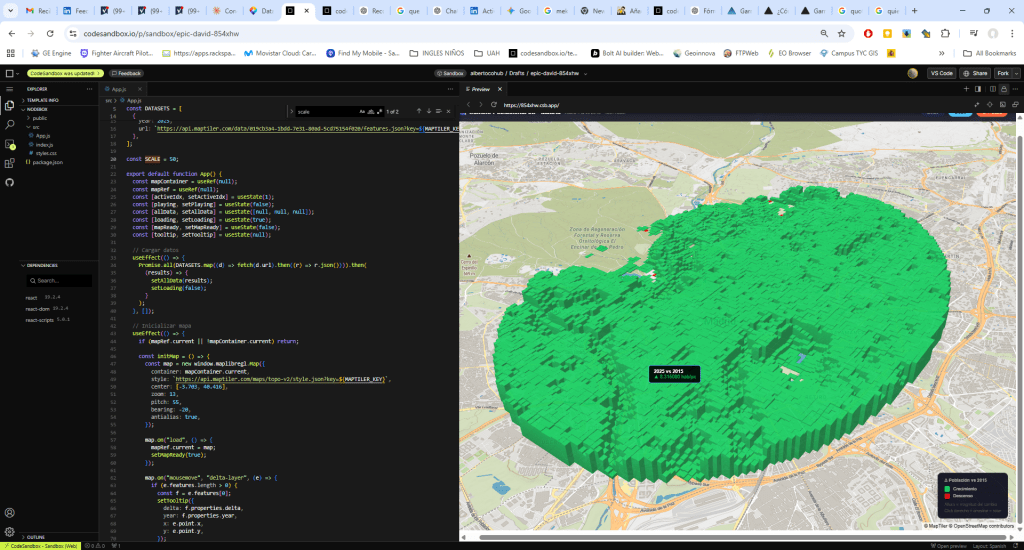

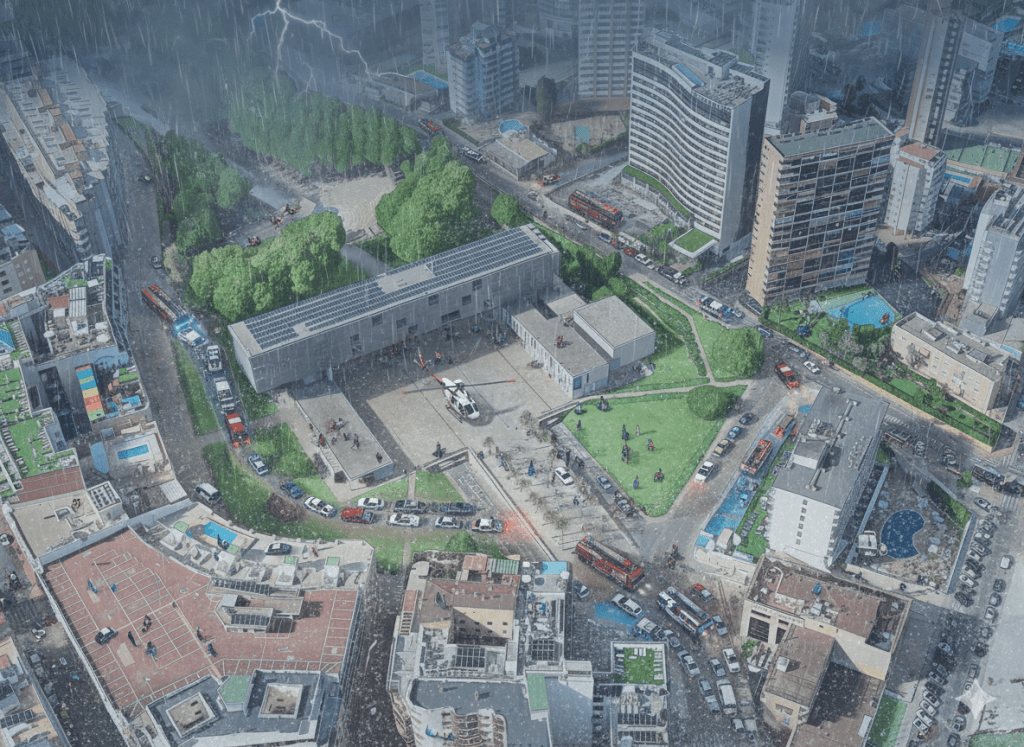

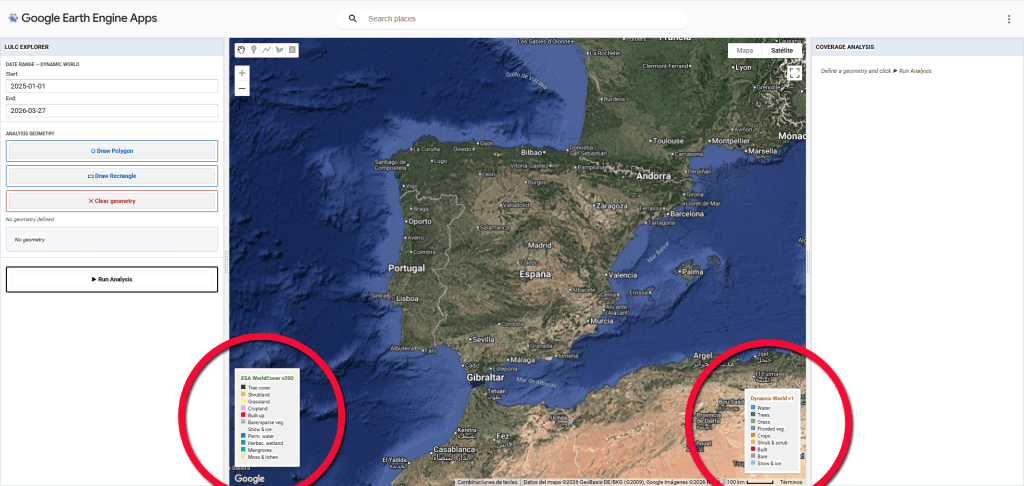

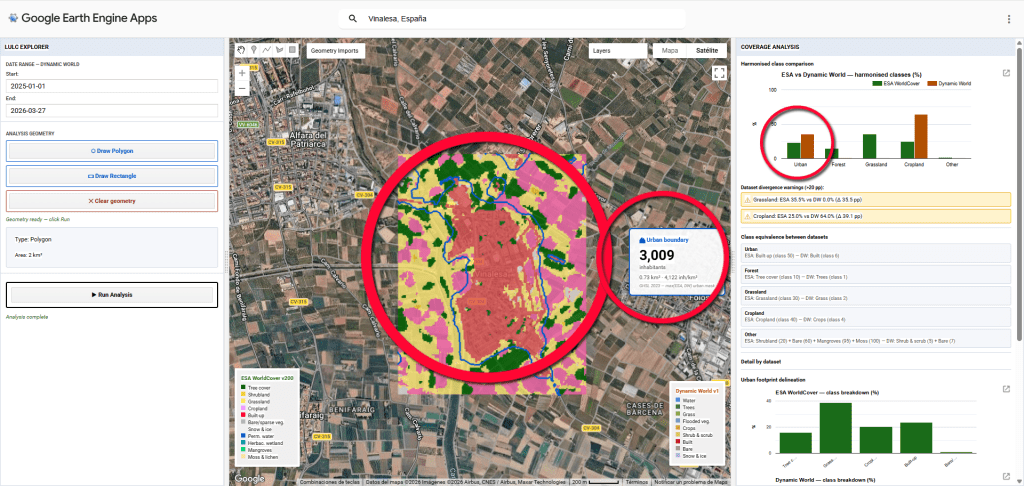

This methodology involves the deployment of a centralized processing interface within the Google Earth Engine (GEE) environment. The provided visualization captures the core interface of the custom GEE application, which serves as the hub for the multi-sensor LULC validation pipeline. Within this dashboard, users can define a specific Area of Interest (AOI)—highlighted here over Spain—and configure key parameters, including temporal ranges for the acquisition of sentinel-derived products. Crucially, the interface is designed to load and compare two primary datasets simultaneously: 10m Dynamic World (near real-time, probability-based LULC) and ESA WorldCover (10m resolution structured LULC). The contrasting classification schemes are represented by the legends on the left and right sides of the map view, which illustrate the varying definitions of ‘Built-up’ and urban areas between the two products. Establishing this visual and statistical comparison at the application level is the prerequisite for calculating the spatial disagreement threshold, or delta, that guides the subsequent merging and population estimation phases.

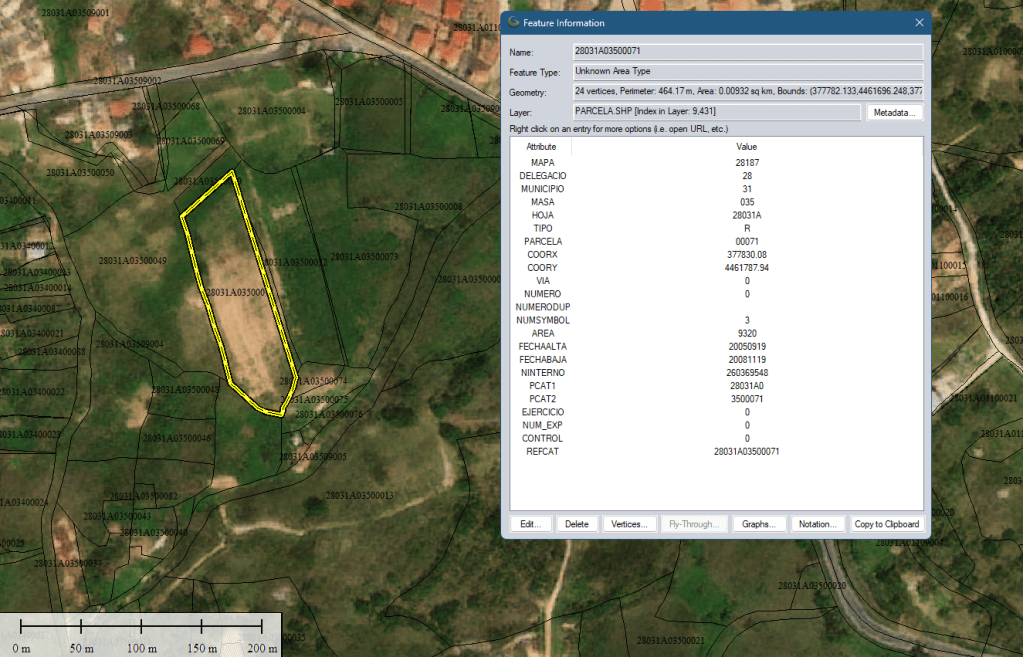

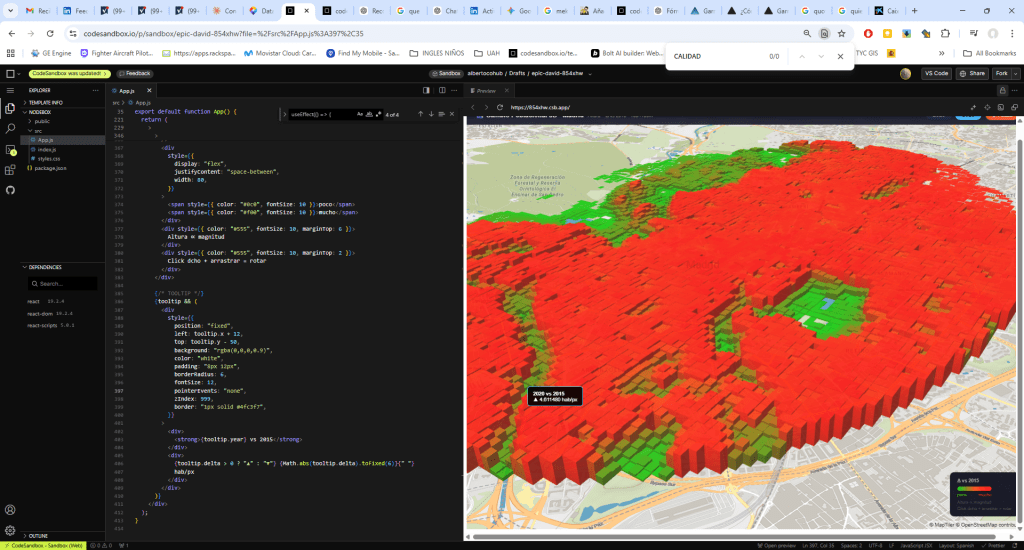

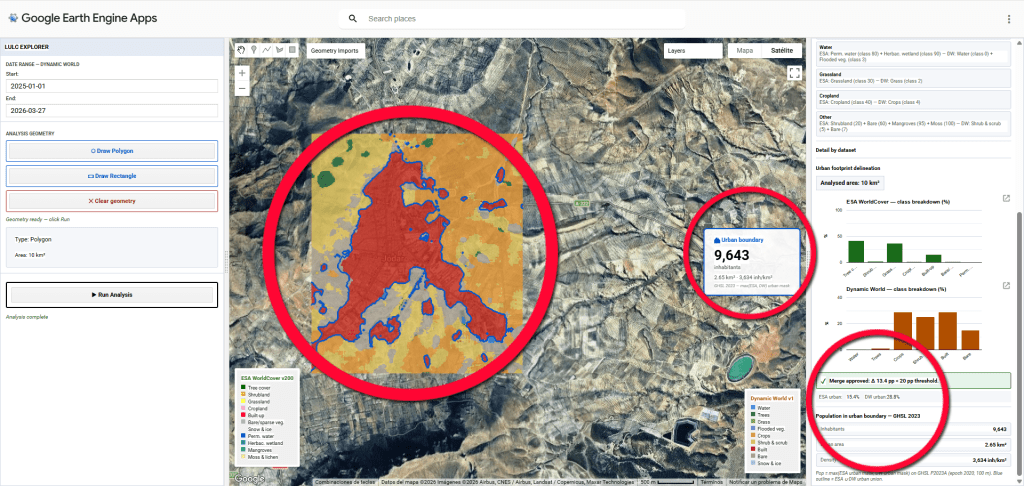

In this stage of the workflow, the application performs a localized comparative analysis within the selected AOI (drawing a rectangle or freehand) cluster. The visualization highlights the spatial intersection between the Dynamic World and WorldCover datasets, where the red-shaded areas represent the high-confidence built-up zones confirmed by both sources.

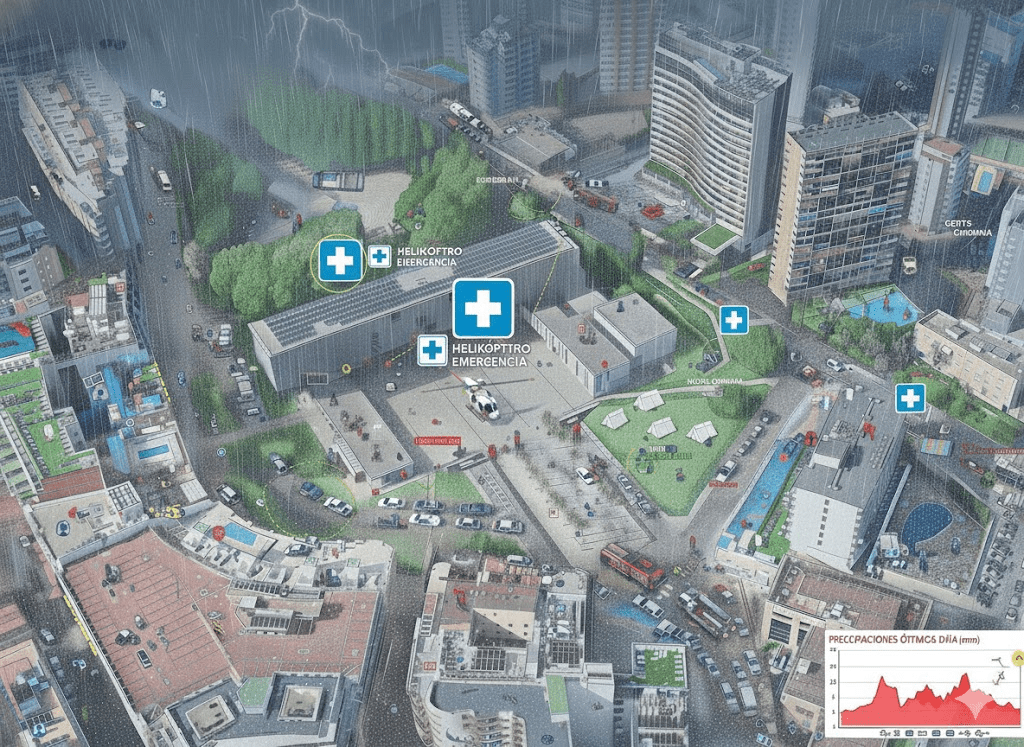

A critical component of this dashboard is the automated calculation of the spatial disagreement (delta); as seen in the right-hand panel, the system evaluates the consistency between the LULC assets. If this delta remains below the 20% threshold, the urban pixels are merged to create a validated settlement mask. This mask then acts as the primary constraint for the population disaggregation phase. The interface displays the final output in real-time—in this instance, estimating a population of 9,643 individuals—by clipping the GHSL 2023 grid to the validated footprint. This ensures that the population count is geographically anchored only to verified human structures, providing a far more precise metric than the generalized figures typically found in administrative boundary datasets.

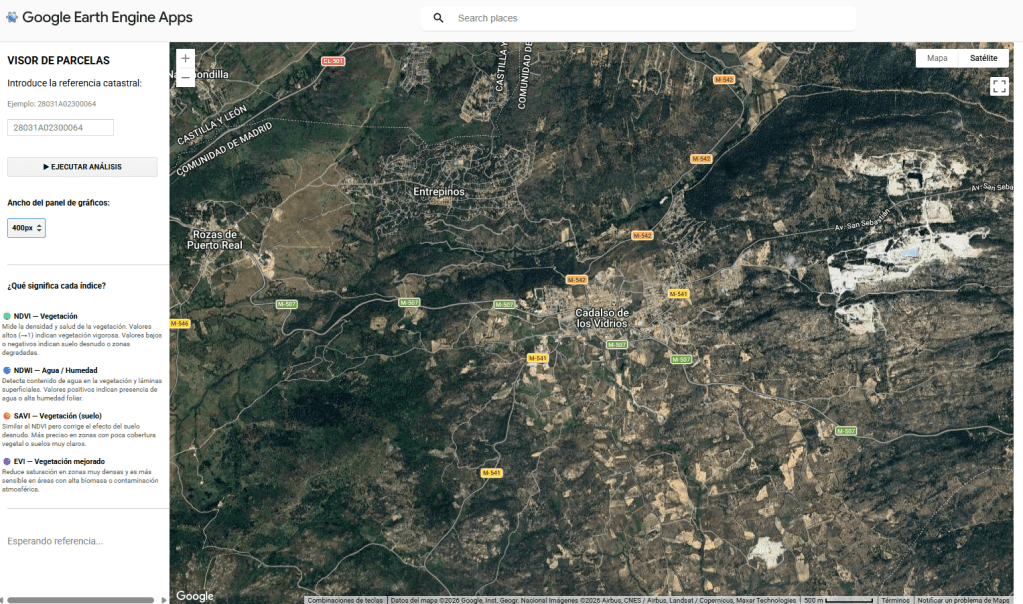

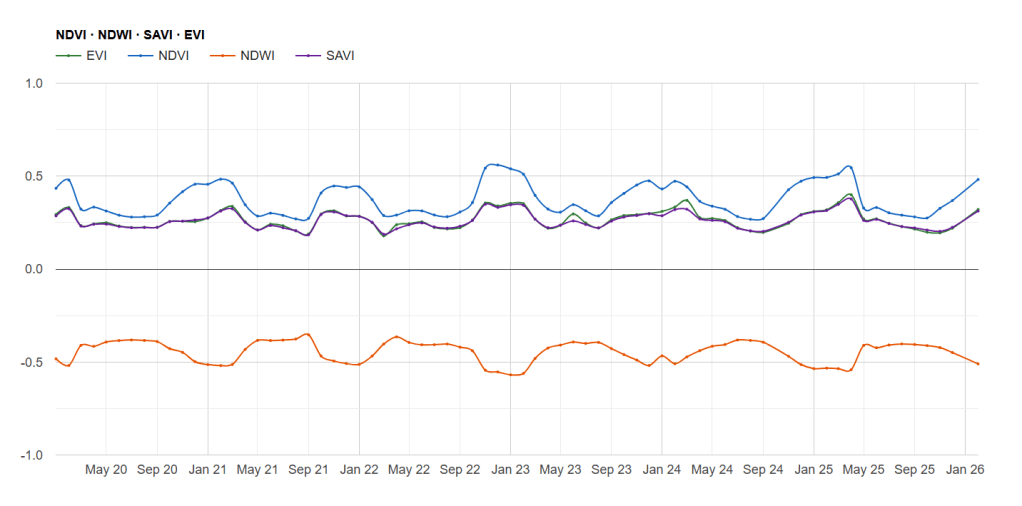

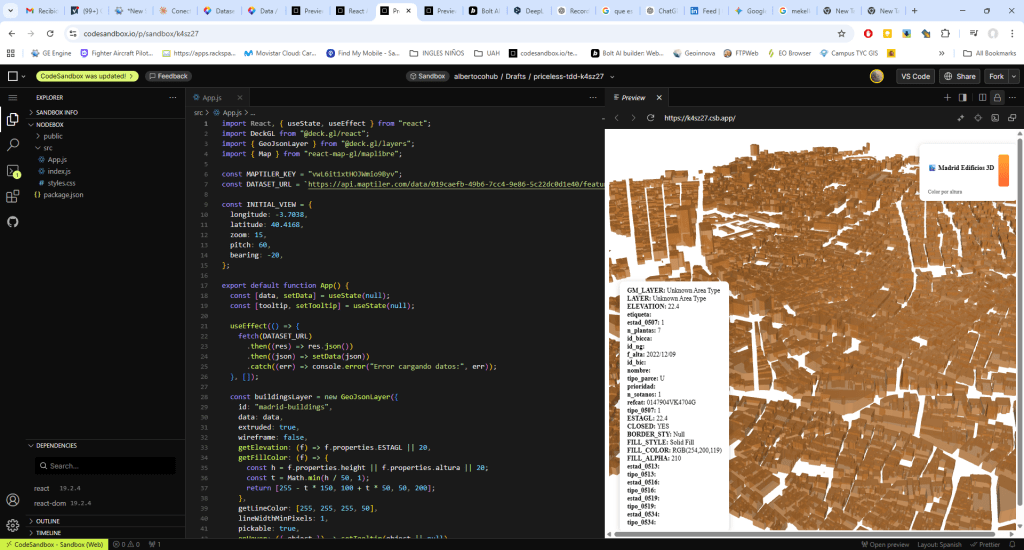

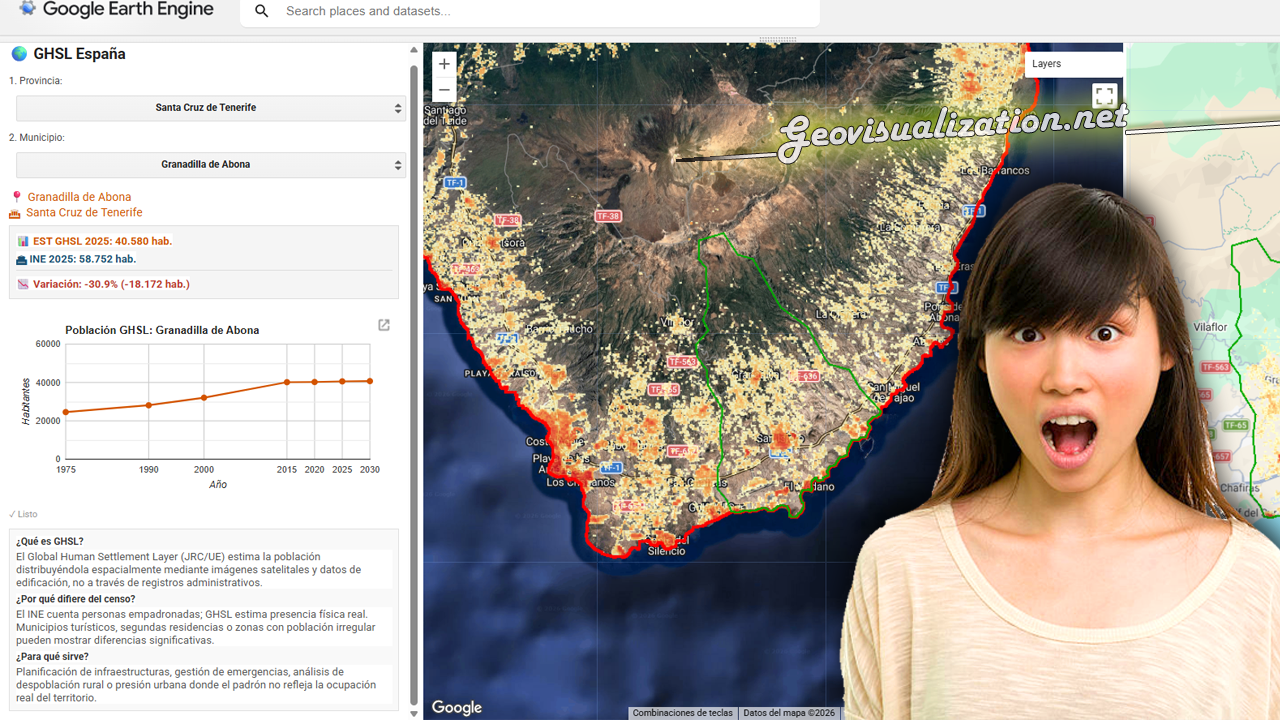

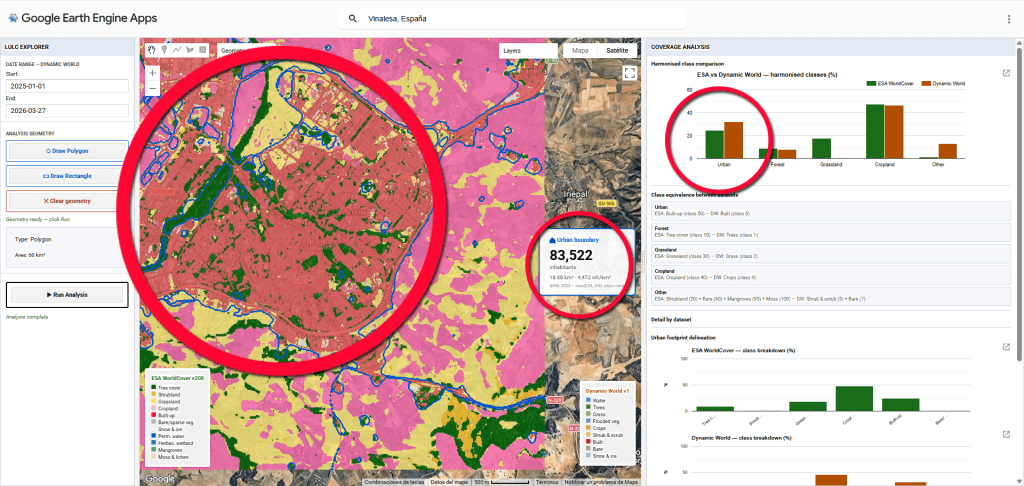

This third capture demonstrates the robustness of the methodology when applied to larger, more complex urban fabrics. In this scenario, the dashboard processes a more extensive metropolitan area, showcasing the comparative histogram between ESA WorldCover and Dynamic World (highlighted in the right-hand panel). These bar charts represent the pixel-wise distribution across various LULC classes, specifically comparing the extent of “Built-up” or “Urban” areas between the two assets. By analyzing these frequency distributions, we can quantitatively assess the spatial agreement before merging.

The visualization confirms that even at this broader scale, the logic remains consistent: the system validates the urban footprint by identifying where the two global products intersect geographically. As shown in the population indicator, the disaggregated estimate for this specific zone reaches 83,522 individuals. This illustrates the scalability of the GEE application, moving seamlessly from small clusters to large urban centers while maintaining the same rigorous validation threshold. The ability to visualize these distributions through real-time charting allows for immediate auditing of the spatial data quality, ensuring that the final population figures are derived from a high-confidence settlement mask rather than a single, potentially biased source.

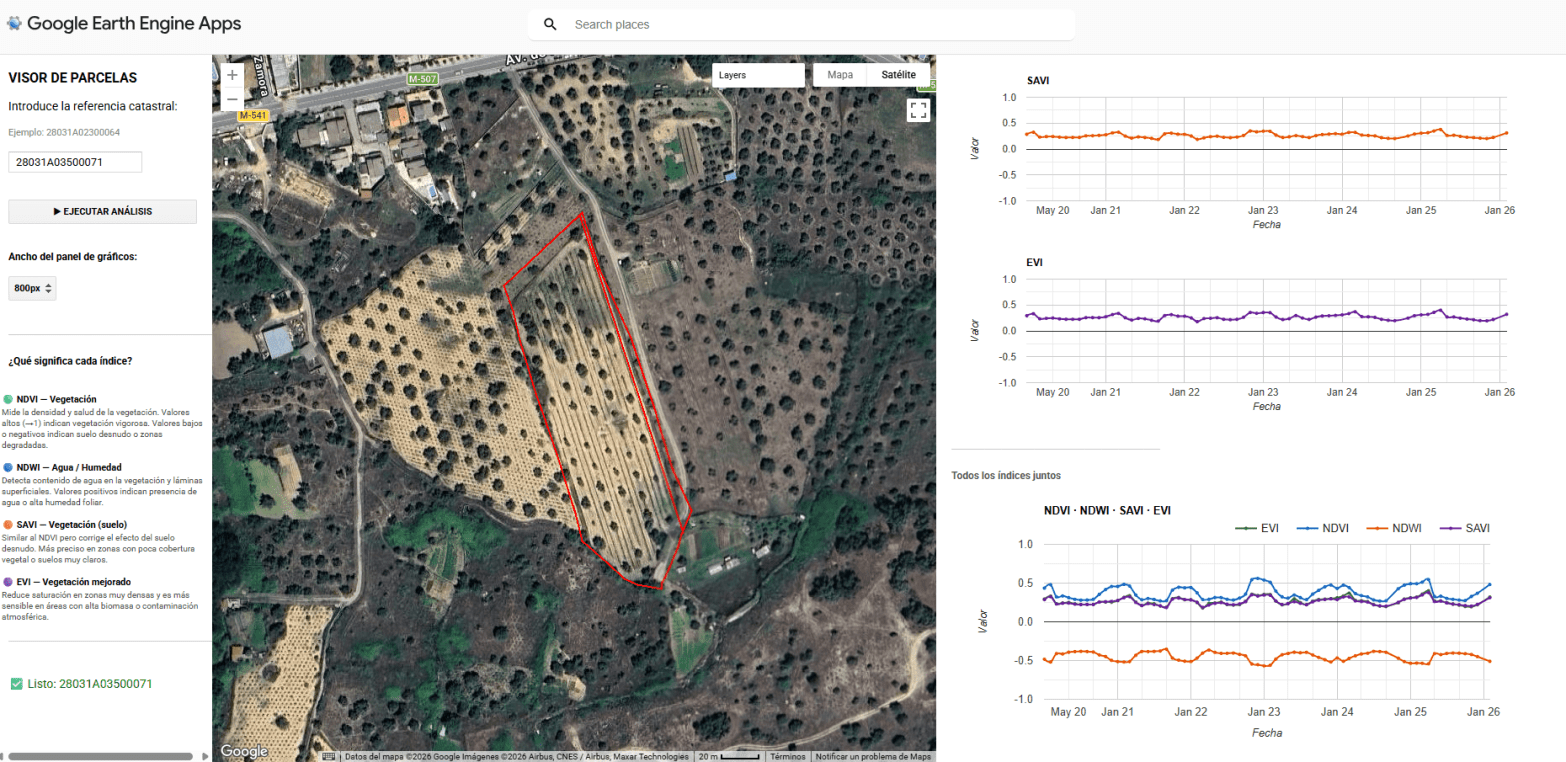

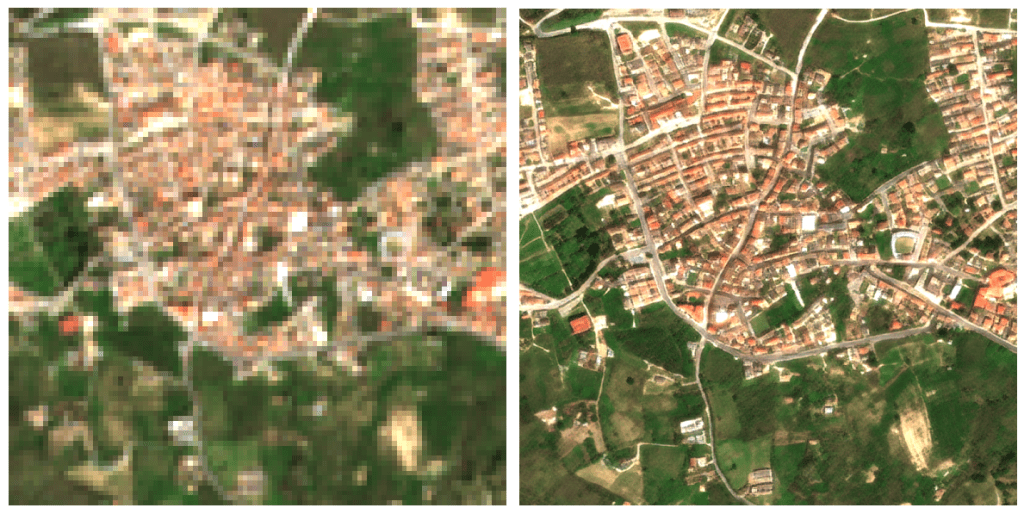

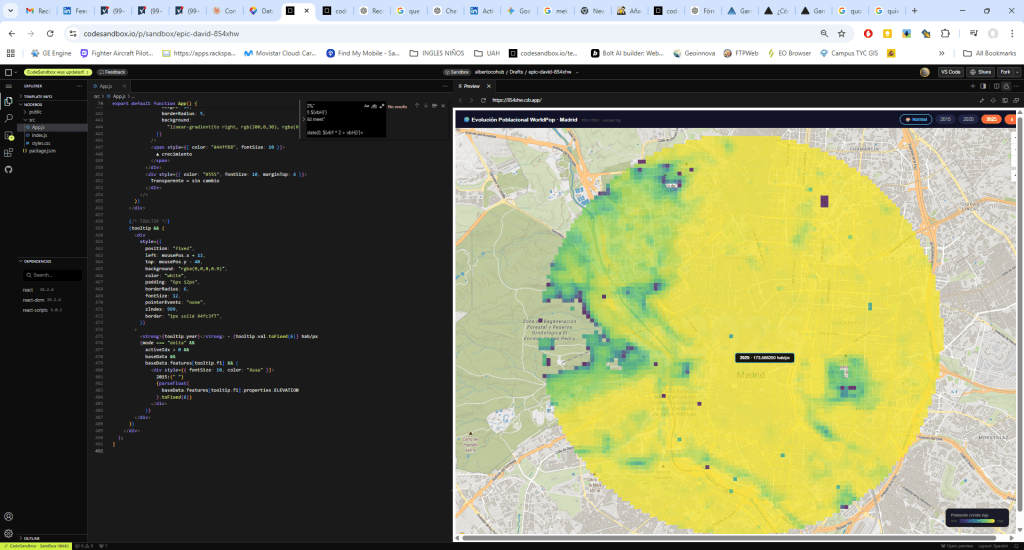

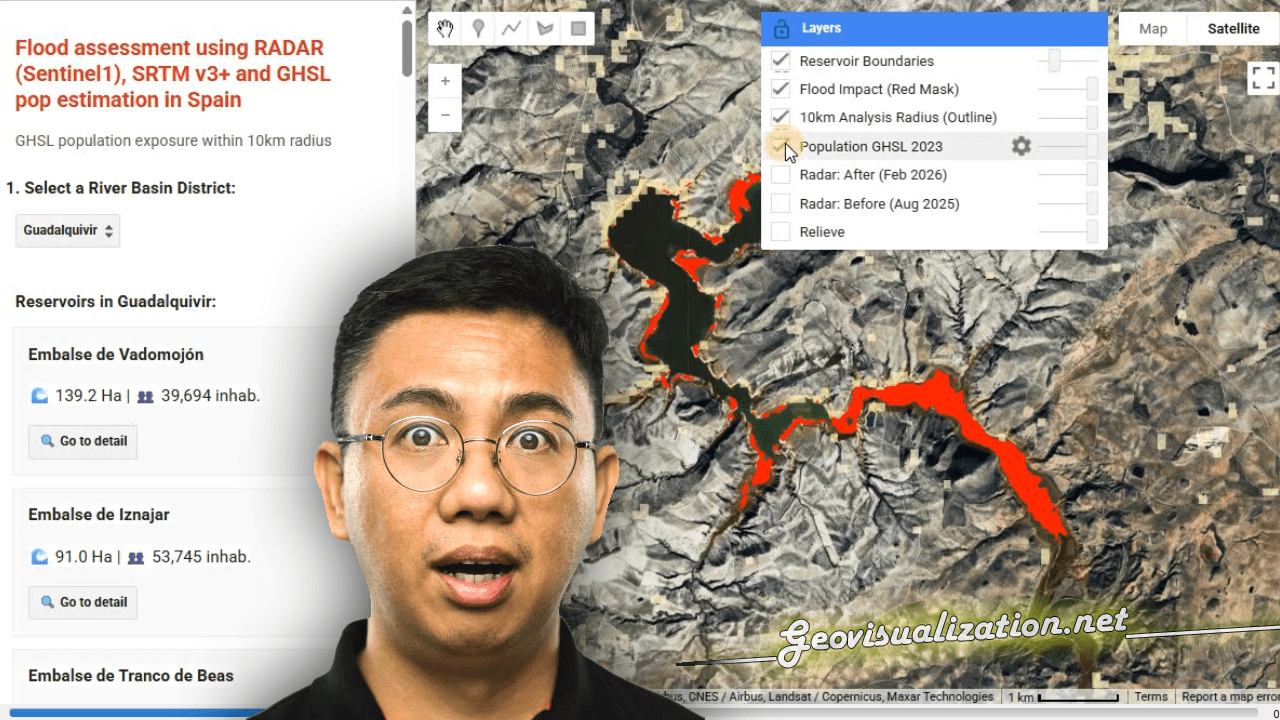

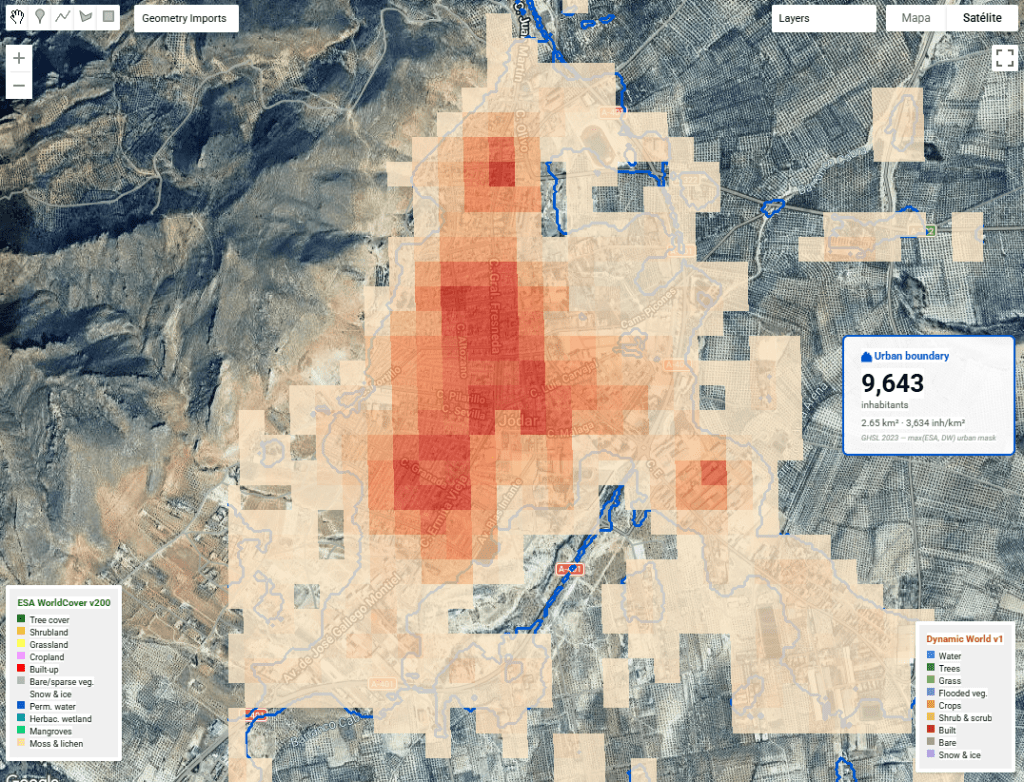

This fourth visualization provides a critical look at the methodology’s sensitivity to agricultural-urban fringes and smaller, isolated settlements. In this specific Area of Interest (AOI), the application processes a more fragmented settlement pattern, where the population estimate is calculated at 3,009 individuals.

The side-panel charting once again highlights the comparative analysis of LULC classes, emphasizing the “Urban” category (marked in the red circle on the histogram). This demonstrates the system’s ability to maintain a rigorous validation threshold even in peri-urban environments where spectral mixing between built-up areas and bare soil or crops is common. By requiring cross-product agreement before merging, the model avoids over-estimating population in rural-urban transition zones—a frequent error in static administrative datasets. The consistency of the population disaggregation, as seen here, proves that the workflow is robust across various settlement morphologies, ensuring that only structurally verified pixels are used to “anchor” the human presence data provided by GHSL 2023.

In summary, the transition from rigid administrative boundaries to dynamic, LULC-validated population modeling represents a significant advancement in urban spatial analytics. By implementing a dual-source validation pipeline—leveraging the temporal frequency of Dynamic World and the structural precision of ESA WorldCover—we create a refined “Human Presence” mask that is far more representative of physical reality. This methodology effectively addresses the Modifiable Areal Unit Problem (MAUP) by anchoring population counts from GHSL 2023 to verified built-up pixels rather than generalized polygons. For researchers and urban planners, this granular approach is not merely a technical refinement; it is a vital tool for identifying socio-spatial vulnerabilities and ensuring that resource allocation is based on high-resolution, empirical evidence of where communities actually thrive. As urban landscapes continue to evolve at an unprecedented pace, these satellite-derived workflows provide the scalability and precision necessary to map the future of our cities accurately.

Hope you like it,

Alberto C.

Geospatial Analyst